El concepto de big data incluye trabajar con información de gran volumen y composición diversa, muy frecuentemente actualizada y ubicada en diferentes fuentes con el fin de aumentar la eficiencia del trabajo, crear nuevos productos y aumentar la competitividad, reúne técnicas y tecnologías que extraen significado de los datos en el último límite de la practicidad.

El Big Data o "grandes datos" implica más que analizar grandes cantidades de información. El problema no es que las organizaciones estén creando cantidades masivas de datos, sino que la mayoría se presenta en un formato que no encaja bien con el formato de base de datos estructurado tradicional, ya sean registros web, videos, documentos de texto, código de máquina o, por ejemplo, por ejemplo, datos geoespaciales. Todo esto se almacena en muchos repositorios diferentes, a veces incluso fuera de la organización. Como resultado, las corporaciones pueden tener acceso a grandes cantidades de sus datos y carecer de las herramientas necesarias para establecer relaciones entre estos datos y sacar conclusiones significativas de ellos. Agregue a eso el hecho de que los datos ahora se actualizan con más frecuencia y tiene una situación en la que los métodos tradicionales de análisis de información no pueden mantenerse al día con las enormes cantidades de datos que se actualizan constantemente grandes datos.

¿CUÁL ES LA DIFERENCIA ENTRE INTELIGENCIA DE NEGOCIOS Y BIG DATA?

El análisis comercial es un proceso descriptivo de analizar los resultados que ha logrado una empresa en un período de tiempo determinado, mientras que la velocidad de procesamiento de big data le permite hacer el análisis predecible, capaz de ofrecer recomendaciones de negocio para el futuro. Las tecnologías de big data también le permiten analizar más tipos de datos que las herramientas de inteligencia comercial, lo que le permite concentrarse en algo más que el almacenamiento estructurado. Si bien los grandes datos y la inteligencia comercial comparten el mismo objetivo (encontrar la respuesta a una pregunta), difieren entre sí en tres aspectos.

Los grandes datos están diseñados para procesar mayores cantidades de información que la inteligencia empresarial y esto, por supuesto, se ajusta a la definición tradicional de grandes datos.

- Big data está diseñado para procesar información que cambia cada vez más rápido, lo que significa una exploración profunda e interactividad. En algunos casos, los resultados se generan más rápido de lo que carga la página web.

- Big data está diseñado para manejar datos no estructurados que solo estamos comenzando a explorar cómo usar después de que hayamos podido recopilarlos y almacenarlos, y necesitamos algoritmos y diálogo para ayudarnos a encontrar las tendencias contenidas en estas matrices.

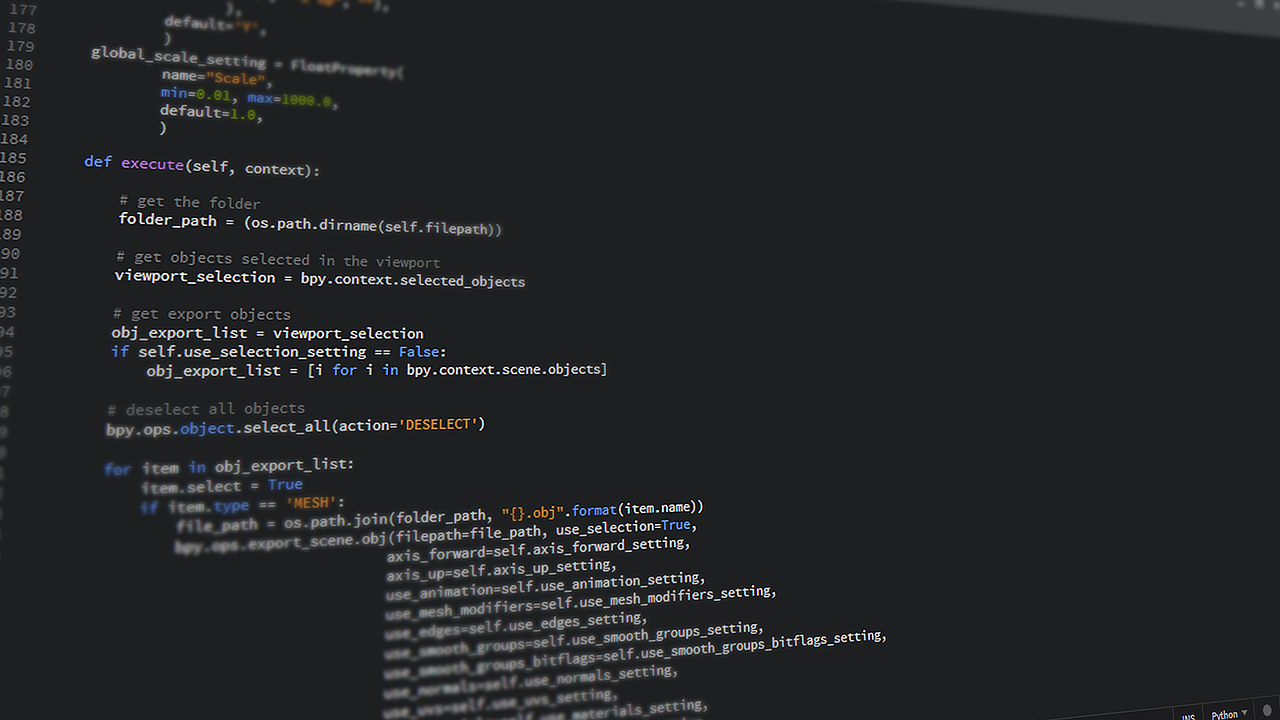

Trabajar con big data no es como un proceso típico de inteligencia de negocios, donde simplemente sumar valores conocidos produce resultados: por ejemplo, sumar las facturas pagadas juntas se convierte en las ventas de un año. Cuando se trabaja con big data, el resultado se obtiene en el proceso de su limpieza a través del modelado secuencial: primero se establece una hipótesis, se construye un modelo estadístico, visual o semántico, a partir del cual se comprueba la corrección de la hipótesis planteada. , y luego se establece el siguiente. Este proceso requiere que el investigador interprete los significados visuales o realice consultas interactivas basadas en el conocimiento, o que desarrolle algoritmos adaptativos de "aprendizaje automático" que puedan producir el resultado deseado. Además, la vida útil de dicho algoritmo puede ser bastante corta.

TÉCNICAS DE ANÁLISIS DE BIG DATA

Existen muchos métodos diferentes para analizar conjuntos de datos, que se basan en herramientas tomadas de la estadística y la informática (por ejemplo, el aprendizaje automático). La lista no pretende ser completa, pero refleja los enfoques más populares en varias industrias. Al mismo tiempo, debe entenderse que los investigadores continúan trabajando para crear nuevos métodos y mejorar los existentes. Además, algunas de las técnicas mencionadas no necesariamente se aplican exclusivamente a big data y se pueden usar con éxito para arreglos más pequeños (por ejemplo, pruebas A/B, análisis de regresión). Por supuesto, cuanto más extensa y diversa se analice la secuencia, más precisos y relevantes se podrán obtener datos en la salida.

- Pruebas A/B . Una técnica en la que una muestra de control se compara con otras. Así, es posible identificar la combinación óptima de indicadores para lograr, por ejemplo, la mejor respuesta del consumidor a una oferta de marketing. big data permite realizar un gran número de iteraciones y así obtener un resultado estadísticamente significativo.

- reglas de asociación de aprendizaje . Un conjunto de técnicas para identificar relaciones, es decir. reglas de asociación entre variables en grandes conjuntos de datos. Se utiliza en la minería de datos .

- clasificación _ Conjunto de técnicas que permiten predecir el comportamiento de los consumidores en un determinado segmento del mercado (decisiones de compra, churn, volumen de consumo, etc.). Se utiliza en la minería de datos .

- análisis de conglomerados . Un método estadístico para clasificar objetos en grupos mediante la identificación de características comunes que no se conocen de antemano. Se utiliza en la minería de datos .

- Colaboración colectiva . Una técnica para recopilar datos de un gran número de fuentes.

- Fusión de datos e integración de datos . Un conjunto de técnicas que permite analizar los comentarios de los usuarios de las redes sociales y compararlos con los resultados de ventas en tiempo real.

- minería de datos Un conjunto de técnicas que le permite determinar las categorías de consumidores más sensibles para un producto o servicio promocionado, identificar las características de los empleados más exitosos y predecir el modelo de comportamiento del consumidor.

- Aprendizaje en conjunto . Este método utiliza muchos modelos predictivos, lo que mejora la calidad de las predicciones realizadas.

- Algoritmos genéticos . En esta técnica, las posibles soluciones se representan como "cromosomas" que se pueden combinar y mutar. Como en el proceso de evolución natural, el individuo más apto sobrevive.

- aprendizaje automático Una rama de la informática (históricamente conocida como "inteligencia artificial") que tiene como objetivo crear algoritmos de autoaprendizaje basados en el análisis de datos empíricos.

- procesamiento del lenguaje natural ( PNL ). Un conjunto de técnicas de reconocimiento de lenguaje natural tomadas de la informática y la lingüística.

- análisis de redes . Un conjunto de técnicas para analizar conexiones entre nodos en redes. En cuanto a las redes sociales, permite analizar la relación entre usuarios individuales, empresas, comunidades, etc.

- optimización _ Un conjunto de métodos numéricos para rediseñar sistemas y procesos complejos para mejorar uno o más indicadores. Ayuda en la toma de decisiones estratégicas, por ejemplo, la composición de la línea de productos presentados al mercado, realización de análisis de inversión, etc.

- reconocimiento de patrones . Conjunto de técnicas con elementos de autoaprendizaje para la predicción de modelos de comportamiento del consumidor.

- modelado predictivo . Conjunto de técnicas que permiten crear un modelo matemático de un escenario probable predeterminado para el desarrollo de eventos. Por ejemplo, analizar la base de datos del sistema CRM en busca de posibles condiciones que obligarán a los suscriptores a cambiar de proveedor.

- regresión _ Un conjunto de métodos estadísticos para identificar patrones entre cambios en una variable dependiente y una o más variables independientes. A menudo se usa para predicciones y predicciones. Se utiliza en minería de datos.

- análisis de sentimientos . Las técnicas para evaluar el sentimiento del consumidor se basan en tecnologías de reconocimiento del lenguaje natural humano. Le permiten aislar mensajes relacionados con un objeto de interés (por ejemplo, un producto de consumo) del flujo general de información. Luego evalúe la polaridad del juicio (positivo o negativo), el grado de emotividad, etc.

- procesamiento de señales Un conjunto de técnicas tomadas de la ingeniería de radio, cuyo objetivo es reconocer una señal en un contexto de ruido y su posterior análisis.

- Análisis espacial . Un conjunto de técnicas, parcialmente tomadas de las estadísticas, para el análisis de datos espaciales: topología del terreno, coordenadas geográficas, geometría de objetos. la fuente de big data en este caso es a menudo los sistemas de información geográfica (SIG).

Conoce más en nuestro Magíster en Ciberseguridad Online (ceupe.cl)

![]() Conecta con nosotros en nuestro perfil de Linkedin: https://www.linkedin.com/in/ceupechile/

Conecta con nosotros en nuestro perfil de Linkedin: https://www.linkedin.com/in/ceupechile/

Comentarios